Die früher am heutigen Tag durchgesickerten Informationen zum Thema Kindersicherheit sind nun offiziell. Auf einer neuen Webseite hat Apple dabei auch Informationen zu dem vorhin thematisierten Abgleich von Fotos auf dem iPhone, iPad und Mac mit Hashwerten zur Erkennung von Kindesmissbrauch bekanntgegeben. Dieser wird allerdings nur ein Teil einer größer angelegten Offensive zum Thema Kindersicherheit sein, die zunächst ausschließlich in den USA, später aber auch in anderen Regionen, mit iOS 15, iPadOS 15 und macOS Monterey umgesetzt wird.

Die früher am heutigen Tag durchgesickerten Informationen zum Thema Kindersicherheit sind nun offiziell. Auf einer neuen Webseite hat Apple dabei auch Informationen zu dem vorhin thematisierten Abgleich von Fotos auf dem iPhone, iPad und Mac mit Hashwerten zur Erkennung von Kindesmissbrauch bekanntgegeben. Dieser wird allerdings nur ein Teil einer größer angelegten Offensive zum Thema Kindersicherheit sein, die zunächst ausschließlich in den USA, später aber auch in anderen Regionen, mit iOS 15, iPadOS 15 und macOS Monterey umgesetzt wird.

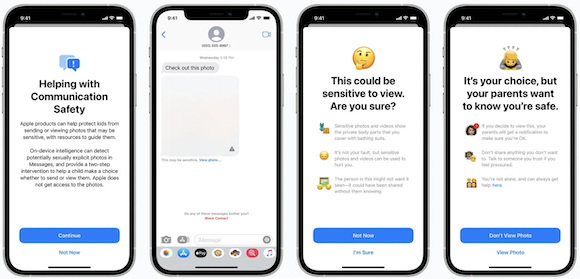

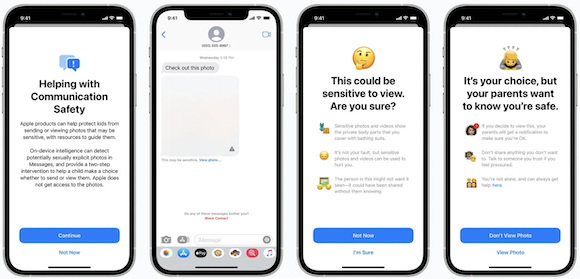

Mit einbezogen wird dabei auch iMessage, welches mit einer "Communication Safety" Funktion ausgestattet wird, die Kinder und ihre Eltern warnt, sobald sexuell anzügliche Fotos empfangen werden. Die Erkennung funktioniert auch in diesem Fall auf Basis von Maschinenlernen und findet komplett lokal auf dem Gerät statt. Sollte die Funktion anspringen, wird das empfangene Bild automatisch verschwommen dargestellt und eine entsprechende Meldung angezeigt. Sind die entsprechenden Schalter in der Familienfreigabe aktiviert, können sich auch Eltern über den Empfang eines solchen Bildes informieren lassen.

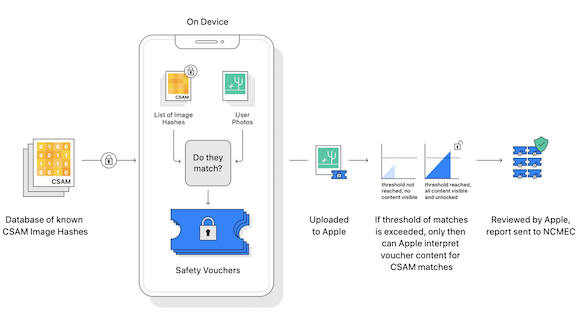

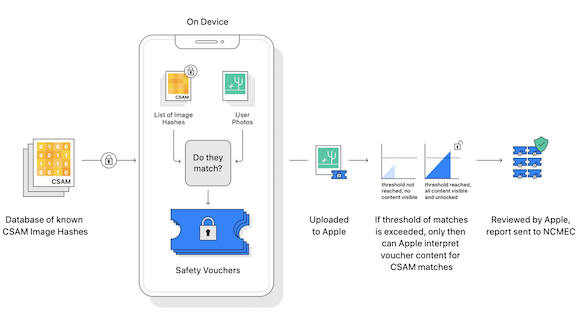

Ebenfalls mit iOS 15 und iPadOS 15 wird Apple die heute Nachmittag thematisierte automatische Erkennung von Bildern mit sogenanntem "Child Sexual Abuse Material" (CSAM), als Darstellungen von sexuellem Missbrauch von Kindern umsetzen. Wurden mehrere solcher Bilder in einem Account entdeckt, meldet Apple dies an das National Center for Missing and Exploited Children (NCMEC), eine Non-Profit -Organisation, die mit den Strafverfolgungsbehörden in den USA zusammenarbeitet. Dabei betont Apple, dass man auch bei der CSAM-Erkennung den Datenschutz in den Mittelpunkt stelle. Wie bereits berichtet, wird die Erkennung der Bilder auf Basis von Hashwerten aus der Datenbank der NCMEC und anderen Organisationen für den Schutz des Kindeswohls durchgeführt. Die dabei zum Einsatz kommende Technologie hört auf den Namen "NeuralHash" und vergleicht Hashwerte von Bildern auf denen Kindesmissbrauch zu sehen ist mit denen auf den Geräten. Hierzu schreibt das Unternehmen in einem neuen Whitepaper:

"The main purpose of the hash is to ensure that identical and visually similar images result in the same hash, while images that are different from one another result in different hashes,. For example, an image that has been slightly cropped, resized or converted from color to black and white is treated identical to its original, and has the same hash."

Die Bilderkennung wird wie gesagt auf dem Gerät selbst durchgeführt, bevor die Fotos auf iCloud Fotos hochgeladen werden. Wurde dabei eine Übereinstimmung festgestellt, wird das Bild entsprechend gekennzeichnet und anschließend hochgeladen. Wurde eine nicht näher benannte Anzahl von Übereinstimmungen bei einem Account festgestellt, werden diese manuell überprüft, der betroffene iCloud-Account deaktiviert und eine Meldung an das NCMEC getätigt. Zwar macht Apple zu dem Vorgang keine konkreten Angaben, versichert aber, dass man für einen "extremely high level of accuracy" sorgen und sogenannte "False-Positives" so weit es geht minimieren werde. Sämtliche Informationen hierzu lassen sich einer veröffentlichten technischen Dokumentation und der neuen Child Safety Webseite entnehmen.

Als dritte Maßnahme wird Apple Anpassungen bei Siri und der Spotlight-Suche auf all seinen Geräten vornehmen, um weiter sicherzustellen, dass sich Eltern und ihre Kinder sicher im Internet bewegen können und schnelle Hilfe in unsicheren Situationen erhalten. Beispielsweise werden entsprechende Ressourcen angeboten, wenn Nutzer Siri fragen, wie und wo sie Kindesmissbrauch melden können.

Wie bereits weiter oben erwähnt, werden sämtliche Neuerungen in diesem Herbst mit iOS 15, iPadOS 15, watchOS 8 und macOS Monterey eingeführt. Dies gilt zunächst ausschließlich für die USA, soll jedoch schrittweise auch auf andere Regionen ausgeweitet werden.

Thriller-Fans dürfen sich auf einen weiteren Neuzugang für Apple TV+ freuen. Wie die Kollegen von Deadline berichten, hat sich Apple die Rechte an "Argylle" einem Spionage-Thriller von Matthew Vaughn gesichert und sich diese satte 200 Millionen Dollar kosten lassen haben. Der Film basiert auf dem kommenden Roman der Schriftstellerin Ellie Conway über den besten Spion der Welt (war dies nicht eigentlich James Bond?) und dessen Aufträge auf der ganzen Welt. Die Dreharbeiten sollen noch in diesem Jahr beginnen und Henry Cavill in der Hauptrolle sehen. Ebenfalls unter der Besetzung befinden sollen sich die Sängerin Dua Lipa, Wrestling-Star John Cena, die Hollywood-Stars Samuel L. Jackson, Sam Rockwell, und Bryan Cranston und viele mehr. Ein konkreter Starttermin steht allerdings noch nicht fest.

Thriller-Fans dürfen sich auf einen weiteren Neuzugang für Apple TV+ freuen. Wie die Kollegen von Deadline berichten, hat sich Apple die Rechte an "Argylle" einem Spionage-Thriller von Matthew Vaughn gesichert und sich diese satte 200 Millionen Dollar kosten lassen haben. Der Film basiert auf dem kommenden Roman der Schriftstellerin Ellie Conway über den besten Spion der Welt (war dies nicht eigentlich James Bond?) und dessen Aufträge auf der ganzen Welt. Die Dreharbeiten sollen noch in diesem Jahr beginnen und Henry Cavill in der Hauptrolle sehen. Ebenfalls unter der Besetzung befinden sollen sich die Sängerin Dua Lipa, Wrestling-Star John Cena, die Hollywood-Stars Samuel L. Jackson, Sam Rockwell, und Bryan Cranston und viele mehr. Ein konkreter Starttermin steht allerdings noch nicht fest. Die früher am heutigen Tag

Die früher am heutigen Tag

Puh, schwieriges Thema... Schon seit einiger Zeit ist das iPhone ja bekanntermaßen in der Lage, die lokal gespeicherten Fotos auf deren Inhalte zu analysieren und dabei beispielsweise Objekte oder auch Gesichter zu erkennen. Diese Funktion wird ab morgen offenbar weiter ausgebaut. So berichtet der Sicherheitsforscher und Professor an der Johns Hopkins University

Puh, schwieriges Thema... Schon seit einiger Zeit ist das iPhone ja bekanntermaßen in der Lage, die lokal gespeicherten Fotos auf deren Inhalte zu analysieren und dabei beispielsweise Objekte oder auch Gesichter zu erkennen. Diese Funktion wird ab morgen offenbar weiter ausgebaut. So berichtet der Sicherheitsforscher und Professor an der Johns Hopkins University  Vor einigen Tagen

Vor einigen Tagen